3 Bibliotheken, die Ihnen helfen, Ihr Modell zu interpretieren

Eine trockene Definition sagt uns, dass die Interpretierbarkeit eines Modells die Fähigkeit ist, die Entscheidungen eines prädiktiven Modells zu genehmigen und zu interpretieren, um Transparenz im Entscheidungsprozess zu ermöglichen. Einfach gesagt…

Eine trockene Definition sagt uns, dass die Interpretierbarkeit eines Modells die Fähigkeit ist, die Entscheidungen eines prädiktiven Modells zu genehmigen und zu interpretieren, um Transparenz im Entscheidungsprozess zu ermöglichen. Einfach gesagt, die Menschen möchten am Steuer sitzen und treffen ihre Entscheidungen gerne selbst. Sie wollen den KI-Modulen nicht einfach blind vertrauen, wie einer magischen Black Box, aus der Vorhersagen fallen. Sie wollen auch eine klare und verständliche Begründung, warum sich das Modell gerade so entschieden hat. Kurz gesagt, die eigenständige, aber unleserliche künstliche Intelligenz wird langsam, aber sicher durch verständliche „erweiterte Intelligenz“ ersetzt. Heute stellen wir drei der besten Bibliotheken vor, die uns dabei helfen können.

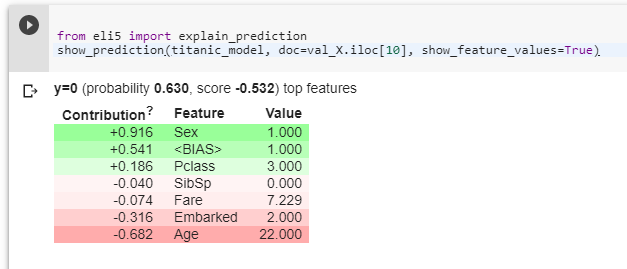

Ich habe alle drei Bibliotheken am Wochenende gründlich getestet und in Colab zum Laufen gebracht, also wenn Sie ein Problem haben, schreiben Sie einfach. Auf dem Bild ist das Gewinner-Modell des Titanic-Projekts von Studenten der Ječná-Gruppe TMT, verbessert durch die ELI5-Bibliothek. Das Bild erklärt, warum das Modell „denkt“, dass Passagier 10 aus dem Testdatensatz nicht überlebt. Das liegt hauptsächlich aus drei Gründen:

- Er ist ein Mann (sex=1)

- Die meisten Menschen auf der Titanic haben nicht überlebt (BIAS)

- Er hat ein Ticket der dritten Klasse gekauft (Pclass=3).

Seine Chancen steigen jedoch leicht, weil:

- er 22 Jahre alt ist (Age=22)

- er in einem guten Hafen eingeschifft wurde (Embarked=2).

Und nun zu den Bibliotheken:

1. LIME (Limetka)

LIME (Local Interpretable Model-agnostic Explanations, also Lokale interpretierbare modellunabhängige Erklärungen) kann auf vertrauenswürdige Weise die Vorhersagen komplexer Modelle erklären, indem es das Modell für den jeweiligen Fall in ein interpretierbares Modell vereinfacht. Limetka ist in der Lage, jedes Modell mithilfe von zwei oder mehr Klassen zu erklären. Derzeit unterstützt LIME zwei Arten von Eingaben: tabellarische und textuelle Daten.

2. SHAP

SHAP (SHapley Additive exPlanations)

Ist eine einheitliche Python-Bibliothek, die die Ausgaben jedes Modells des maschinellen Lernens erklärt. Sie verbindet Spieltheorie mit Erklärungen. Sie vereint mehrere vorherige Methoden und stellt eine konsistente und lokal präzise Methode zur Zuordnung von Merkmalen basierend auf Erwartungen dar.

3. ELI5

ELI5 ermöglicht die Visualisierung und Feinabstimmung verschiedener Modelle des maschinellen Lernens über eine einheitliche API. Diese Bibliothek hilft dabei, Klassifikatoren des maschinellen Lernens zu optimieren und deren Vorhersagen zu erklären. Sie bietet Unterstützung für beispielsweise sci-kit, XGBoost, LightGBM, CatBoost usw. Diese Bibliothek implementiert auch mehrere Algorithmen zur Überprüfung von Black-Box-Modellen, wie TextExplainer, der es ermöglicht, die Vorhersagen eines beliebigen Textklassifikators mithilfe des LIME-Algorithmus und der Permutationsmethode zu erklären, die zur Berechnung der Wichtigkeit von Merkmalen und zur Schätzung von Black-Boxen verwendet werden kann.

Quellen:

Lime: https://github.com/marcotcr/lime

Shap: https://github.com/slundberg/shap

Eli 5: https://github.com/TeamHG-Memex/eli5

Freely based on: https://www.analyticsindiamag.com/4-python-libraries-for-getting-better-model-interpretability/

Originalquelle: wordpress