Eine Frage statt zehn Benchmarks: Mini-IQ-Test für die neuesten KI-Modelle

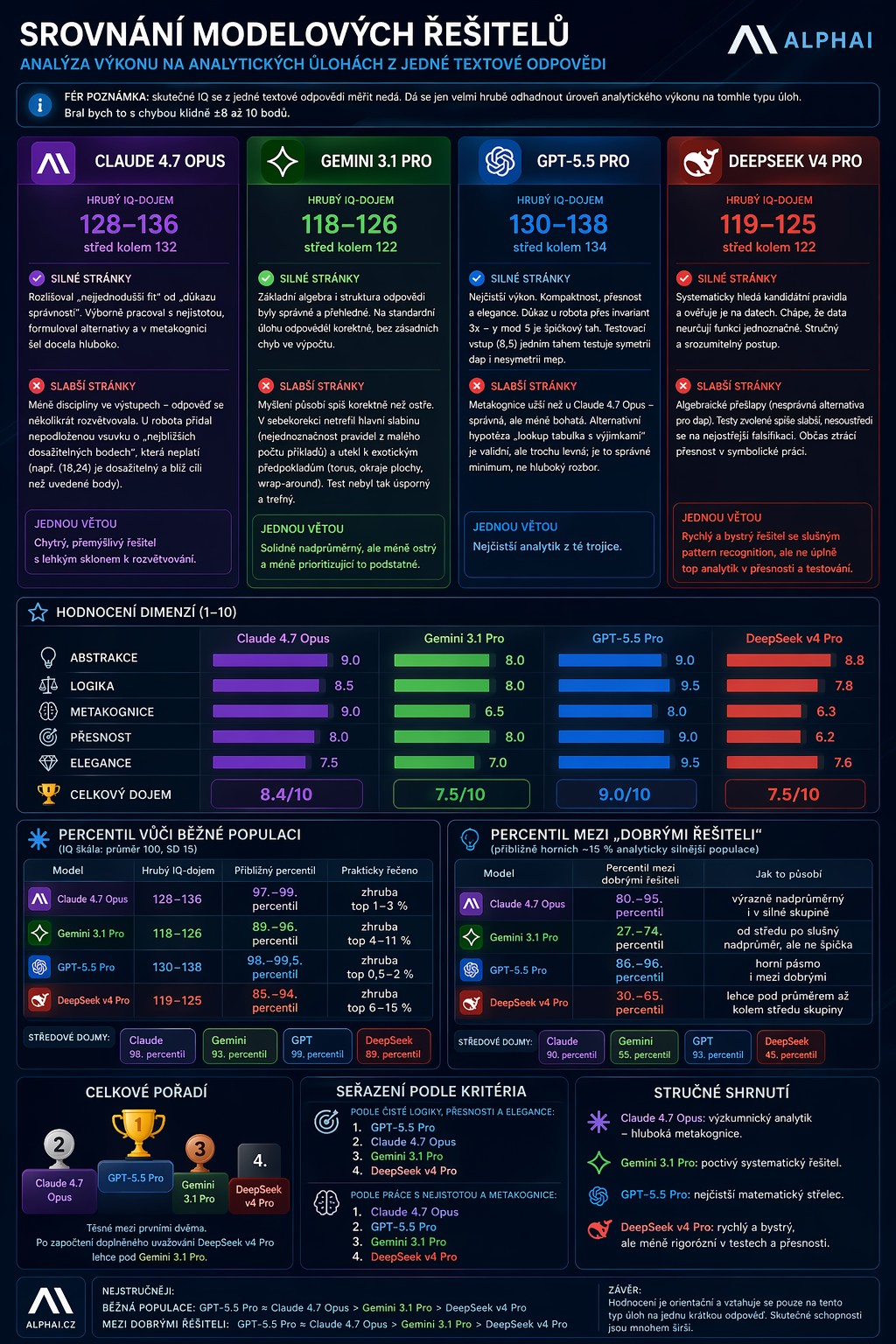

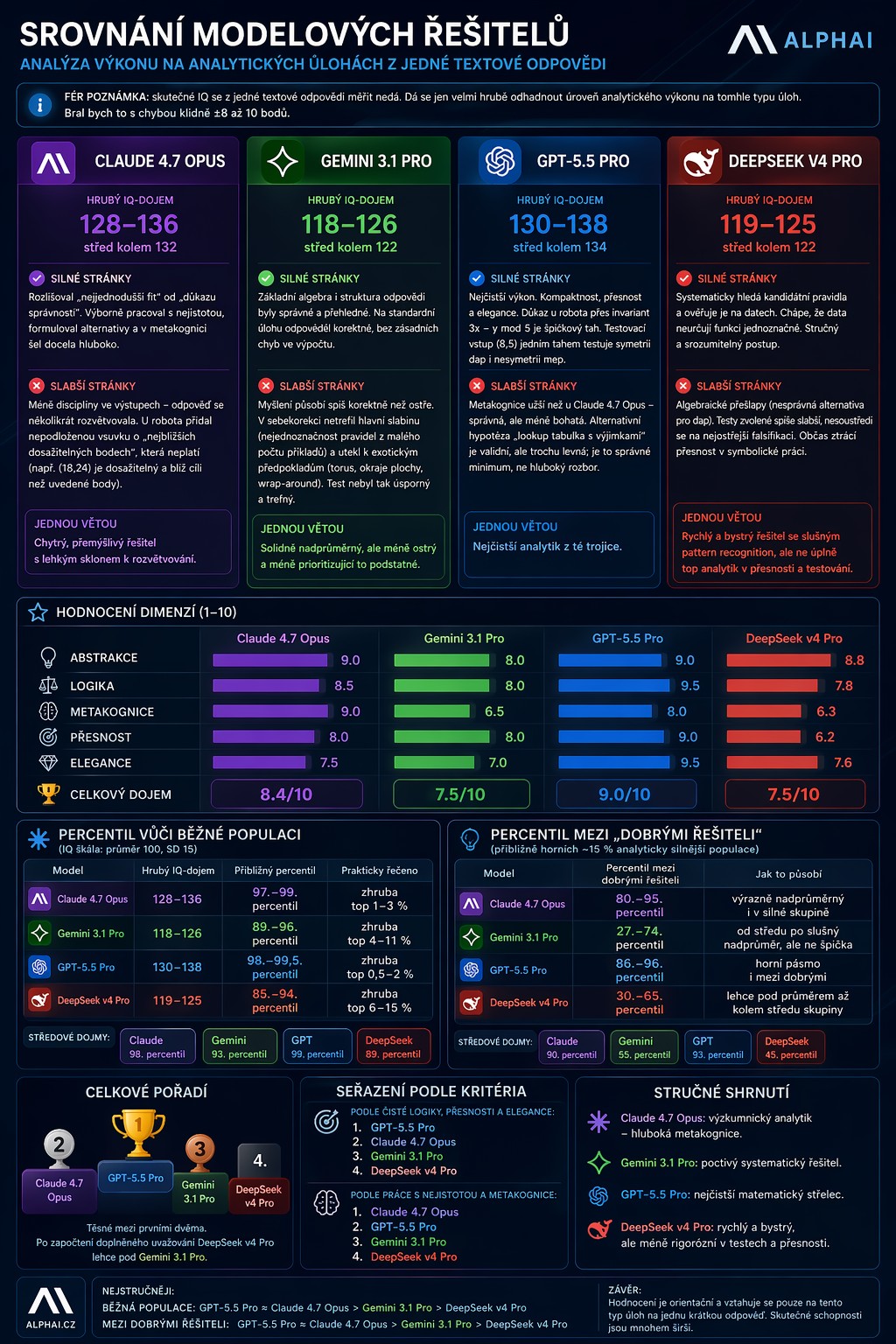

Ich habe die neuesten Top-KI-Modelle genommen und ihnen statt endloser Benchmarks eine einzige „geniale“ Frage gestellt: das versteckte Regel zu entdecken, einen neuen Fall zu berechnen, die Mehrdeutigkeit zuzugeben, einen Falsifikationstest vorzuschlagen und ihre eigene Lösung zu kritisieren. Das Ergebnis? Die Spitze liegt heute etwa im Bereich von 120–135+ IQ-Eindruck — aber der Unterschied liegt nicht mehr darin, was die Modelle wissen, sondern wie klar sie unter Druck denken können.

Ich habe die neuesten Top-KI-Modelle genommen und ihnen statt endloser Benchmarks eine einzige „geniale" Frage gestellt: das versteckte Regel zu entdecken, einen neuen Fall zu berechnen, die Mehrdeutigkeit zuzugeben, den besten Falsifikationstest vorzuschlagen und schließlich ihre eigene Lösung zu kritisieren.

Und genau das ist das Interessante: es ging nicht um Gedächtnis oder um eine Enzyklopädie von Fakten, sondern um rohes Denken unter Druck. Umso mehr, da es sich um Modelle handelt, die praktisch „frisch aus dem Ofen" kommen:

- DeepSeek V4 wurde heute, 24. April 2026, veröffentlicht

- OpenAI hat GPT-5.5 am 23. April 2026 angekündigt

- Anthropic hat Claude Opus 4.7 am 16. April 2026 vorgestellt, also nur wenige Tage zuvor

Das Ergebnis? Eine Frage hat mehr enthüllt als zehn schöne Demo-Beispiele. Die besten Modelle gewinnen nicht, weil sie „die Antwort wussten", sondern weil sie elegante Beweise finden, die Unsicherheit präzise benennen und selbst einen Test vorschlagen, der sie vom Tisch fegen könnte.

Als wir ihre Leistung in unseren groben IQ-Eindruck umwandelten, kam die Spitze ziemlich hoch heraus: etwa im Bereich von 120 bis 135+, natürlich nicht als klinisches IQ, sondern als orientierende Maßstab analytischer Schärfe.

Mit anderen Worten: Die Unterschiede zwischen den Top-Modellen ergeben sich heute nicht nur daraus, „wie viel sie wissen", sondern wie klar, hart und ehrlich sie denken können.

Detaillierte Bewertung über die Modelle, Dimensionen und Perzentile — siehe Infografik oben. Die Vorschau im Blogbeitrag ist aus technischen Gründen beschnitten; das vollständige Bild wird erst hier im Artikel angezeigt.

Probieren Sie es auch — Mini-IQ-Test für Menschen und KI

Wenn Sie diesen Test ausprobieren möchten, lösen Sie die folgende Aufgabe:

mep(2,5)=12

mep(3,4)=15

mep(4,7)=32

mep(1,9)=10

mep(0,6)=0

mep(5,0)=5

dap(2,5)=29

dap(3,4)=25

dap(4,7)=65

dap(1,9)=82

dap(0,6)=36

dap(5,0)=25

Leiten Sie die Regeln mep und dap ab.

- Wenn es mehrere mögliche Regeln gibt, sagen Sie das ausdrücklich.

- Berechnen Sie:

mep(5,8)=?unddap(5,8)=? - Schlagen Sie einen weiteren Eingang vor, der Ihre Hypothese am besten widerlegen könnte.

- Und schließlich schreiben Sie, worüber Sie in Ihrer Antwort am wenigsten sicher sind.

Was sagen die Leute in den Kommentaren?

Der Beitrag hat auf FB eine ziemlich vielfältige Diskussion ausgelöst, und es lohnt sich, sie zusammenzufassen — denn sie war auch Teil des Experiments.

Die meisten Reaktionen bezogen sich auf die Methodologie selbst: dass Benchmarks schließlich nicht eine Sache messen, sondern ein ganzes Spektrum an Fähigkeiten. Das ist natürlich wahr — in der Praxis arbeite ich mit einer Gruppe von etwa 150 brauchbaren Modellen und Dutzenden von offiziellen und inoffiziellen Benchmarks, bei denen ich kreatives Schreiben, Informationsgewinnung aus Bildern, Erstellung von Präsentationen, Geschwindigkeit, Kosten, Halluzinationsrate und den CO2-Fußabdruck beobachte. Diese „eine Frage" ersetzt also keine Benchmarks — es ist ein schneller Sanity-Check, so eine Art Lackmustest für die Klarheit des Denkens.

Andere in den Kommentaren teilten ihre eigenen Erfahrungen mit dem Wechsel zwischen Modellen: jemand wechselte von ChatGPT zu Gemini wegen besserer Ratschläge rund um den PC, ein anderer bezeichnete ChatGPT als halluzinierenden Veteranen und Claude als „eine andere Liga". Und genau das ist das Bild, das ich auch in den Daten sehe: kein Modell gewinnt heute alles — es gewinnt dort, wo seine Stärke zu Ihrem Anwendungsfall passt.

Dann kamen auch Kommentare wie „triviale Aufgabe" oder „vollkommener Unsinn". Ja, das Rätsel selbst ist mathematisch banal — mep(a,b) = a·(b+1) und dap(a,b) = a²+b². Aber der Sinn des Tests war nicht, es zu lösen — der Sinn war zu beobachten, ob das Modell:

- sieht, dass 6 Punkte die Funktion eindeutig nicht bestimmen,

- selbst einen Falsifikationseingang vorschlägt, der die Hypothese von konkurrierenden unterscheidet,

- und ehrlich zugeben kann, was es nicht sicher weiß.

Und dort zeigen sich die echten Unterschiede. Einige Modelle ertrinken in Selbstvertrauen, andere — wie Claude Opus 4.7 — unterscheiden explizit zwischen symmetrischen und asymmetrischen Regeln, schlagen einen Test wie mep(5,2) vor (wo 12 vs. 15 über die Kommutativität entscheidet) und sagen offen, dass ohne diesen Test ihre Berechnungen mep(5,8)=45 und dap(5,8)=89 von der Gültigkeit der einfachsten Hypothese abhängen.

Das ist genau die Art des Denkens, die Sie in herkömmlichen Benchmarks einfach nicht sehen werden. Und genau deshalb macht es Sinn, gelegentlich die „großen Modelle" durch eine kleine, harte Frage zu lassen.

Werden Sie die Aufgabe lösen — Sie oder Ihr Lieblingsmodell? Lassen Sie mich wissen, wie es ausgegangen ist.