Jedno pytanie zamiast dziesięciu benchmarków: mini test IQ dla najnowszych modeli AI

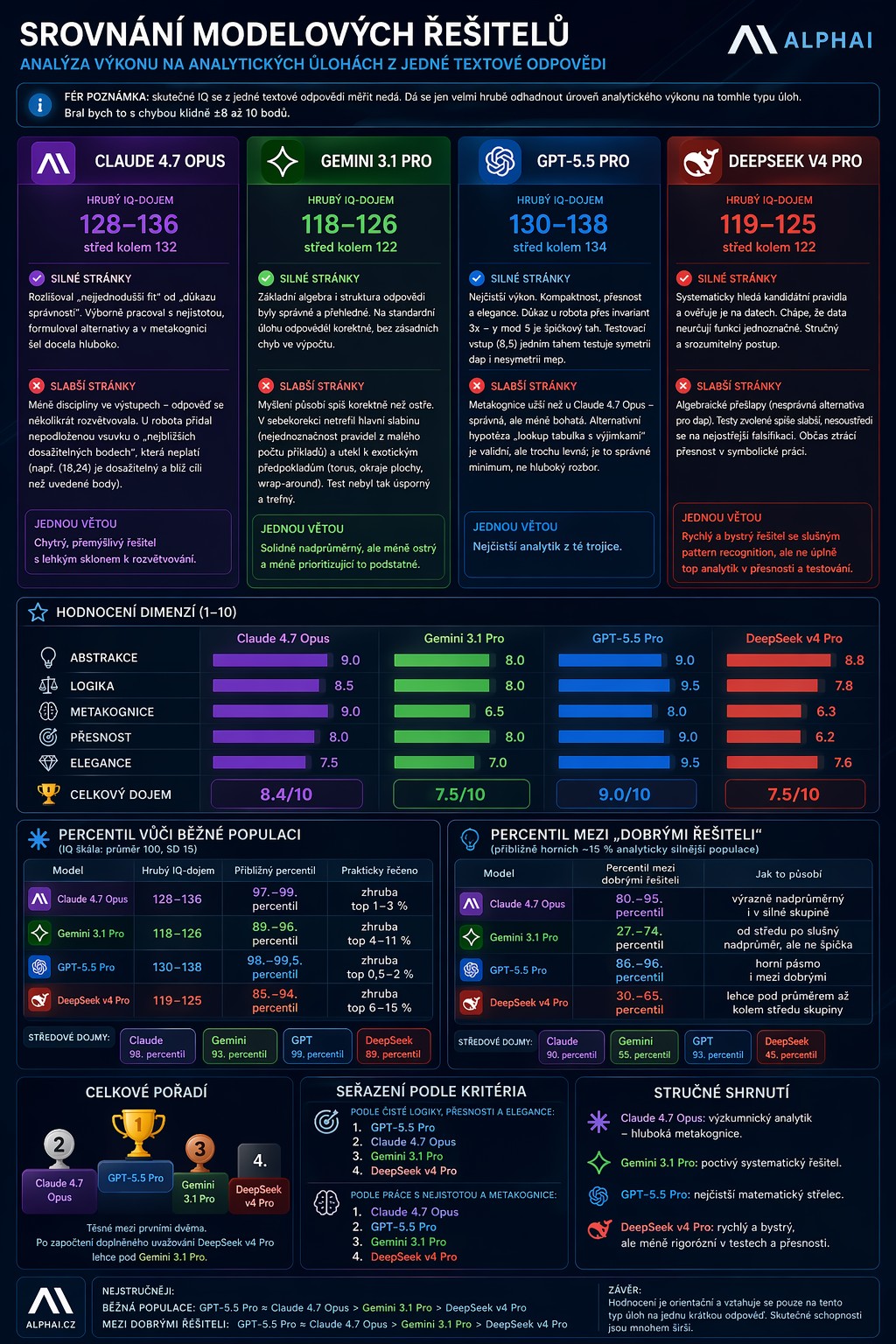

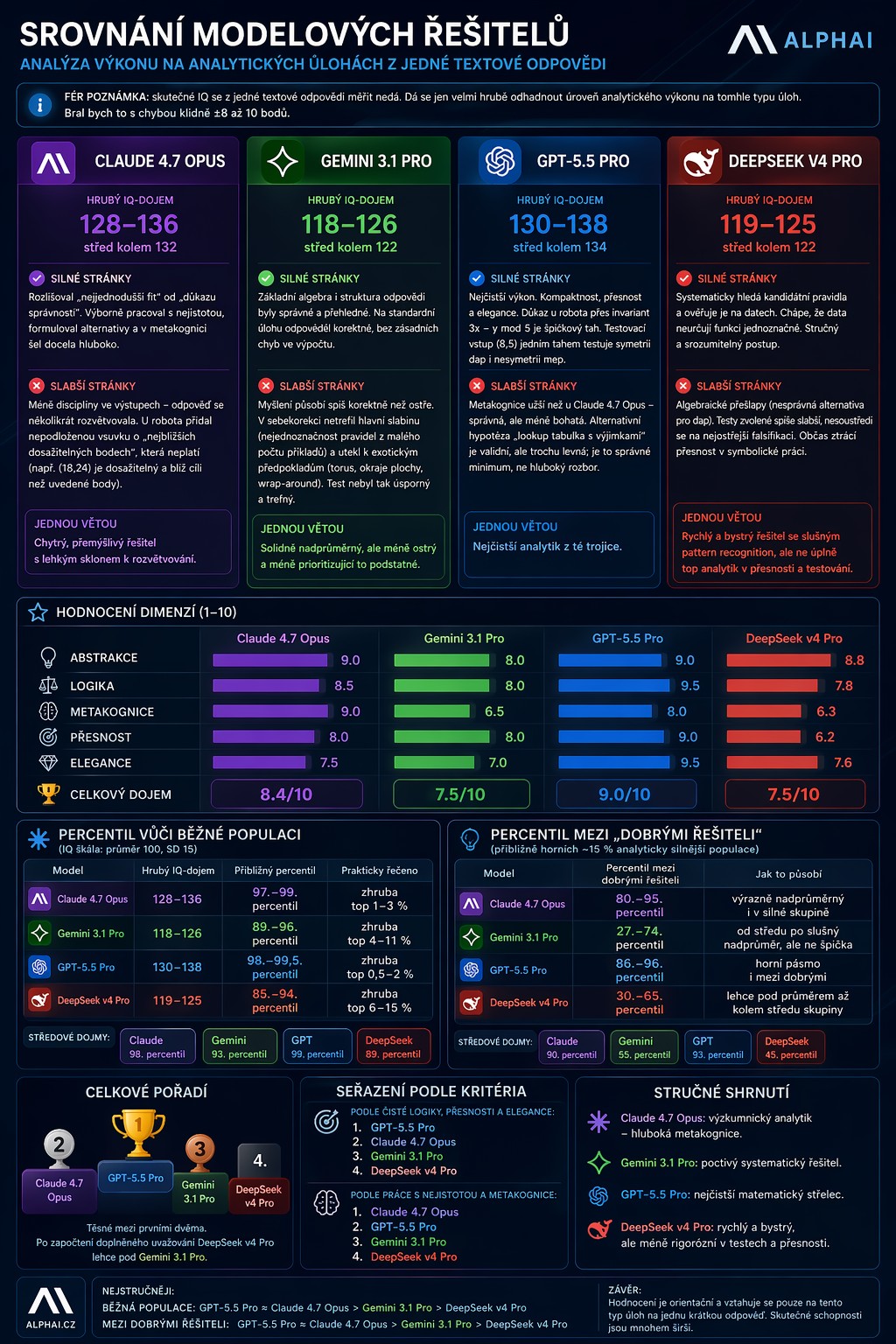

Wziąłem najnowsze najlepsze modele sztucznej inteligencji i zamiast niekończących się testów porównawczych zadałem im jedno „genialne” pytanie: odkryj ukrytą regułę, oblicz nowy przypadek, przyznaj się do niejednoznaczności, zaprojektuj test fałszowania i przeanalizuj własne rozwiązanie. Wynik? Dzisiejszy szczyt mieści się mniej więcej w przedziale 120–135+ IQ – ale różnica nie polega już na tym, co wiedzą modele, ale na tym, jak wyraźnie potrafią myśleć pod presją.

Wziąłem najnowsze najlepsze modele sztucznej inteligencji i zamiast niekończących się testów porównawczych zadałem im jedno „genialne” pytanie: odkryj ukrytą regułę, oblicz nowy przypadek, przyznaj się do niejednoznaczności, zaprojektuj najlepszy test fałszowania i na koniec skrytykuj własne rozwiązanie.

I właśnie to jest w tym ciekawe: nie była to pamięć ani encyklopedia faktów, ale surowe myślenie pod presją. Tym bardziej, że były to praktycznie modele „od razu po wyjęciu z pudełka”:

- DeepSeek V4 wydany dzisiaj, 24. 4. 2026

- OpenAI ogłosiło GPT-5.5 23. 4. 2026

- Antropiczny wydany Claude Opus 4.7 16. Kwiecień 2026, czyli zaledwie kilka dni wcześniej

Wynik? Jedno pytanie ujawniło ponad dziesięć fajnych wersji demonstracyjnych. Najlepsze modele nie wygrywają dzięki „znaniu odpowiedzi”, ale dzięki możliwości znalezienia eleganckiego dowodu, dokładnego nazwania niepewności i samodzielnego zaprojektowania testu, który może ich zrzucić ze stołu.

Kiedy przeliczyliśmy ich wyniki na nasze przybliżone wrażenie IQ, szczyt okazał się dość wysoki: mniej więcej w przedziale 120 do 135+, oczywiście nie jako kliniczny IQ, ale jako orientacyjna miara ostrości analitycznej.

Innymi słowy: różnica między dzisiejszymi topowymi modelkami nie polega już tylko na tym, „ile wiedzą”, ale na tym, jak czysto, mocno i uczciwie potrafią myśleć.

Szczegółowy podział ocen według modeli, wymiarów i percentyli — patrz infografika powyżej. Podgląd listy blogów jest obcięty ze względów technicznych; pełny obraz jest wyświetlany tylko w tym artykule.

Wypróbuj też — mini test IQ zarówno dla ludzi, jak i sztucznej inteligencji

Jeśli chcesz wypróbować ten test, rozwiąż następujące zadanie:

mep(2,5)=12

mep(3,4)=15

mep(4,7)=32

mep(1,9)=10

mep(0,6)=0

mep(5,0)=5

dap(2,5)=29

dap(3,4)=25

dap(4,7)=65

dap(1,9)=82

dap(0,6)=36

dap(5,0)=25

Wydedukuj zasadymepidap.

- Jeśli istnieje więcej niż jedna możliwa reguła, powiedz to wyraźnie.

- Oblicz:

mep(5,8)=?idap(5,8)=? - Zaproponuj jeden dodatkowy wkład, który najlepiej obali Twoją hipotezę.

- Na koniec napisz, czego jesteś najmniej pewien w kwestii swojej odpowiedzi.

Co myślą ludzie w komentarzach?

Wpis wywołał dość zróżnicowaną dyskusję na FB i warto go podsumować — bo była częścią eksperymentu.

Większość reakcji dotyczyła samej metodologii: że benchmarki nie mierzą jednej rzeczy, ale całe spektrum możliwości. To oczywiście prawda — w praktyce pracuję z grupą około 150 użytecznych modeli i dziesiątkami oficjalnych i nieoficjalnych benchmarków, gdzie monitoruję kreatywne pisanie, wydobywanie informacji z obrazów, budowanie prezentacji, szybkość, cenę, współczynnik halucynacji i ślad węglowy. Zatem to „jedno pytanie” nie zastępuje testów porównawczych — jest to szybkie sprawdzenie zdrowego rozsądku, rodzaj papierka lakmusowego czystości myślenia.

Jiní v komentářích sdíleli své vlastní zkušenosti s přechodem mezi modely: někdo přešel z ChatGPT na Gemini kvůli lepším radám okolo PC, jiný označil ChatGPT za halucinujícího weterana a Claude za „jinou ligu”. I właśnie taki obraz widzę w danych: żaden model nie wygrywa dziś wszystkiego — wygrywa tam, gdzie jego mocne strony odpowiadają Twojemu przypadkowi użycia.

Potem pojawiły się komentarze typu „trywialne zadanie” lub „kompletny nonsens”. Tak, sama zagadka jest matematycznie banalna —mep(a,b) = a·(b+1)idap(a,b) = a²+b². Ale celem testu nie było rozwiązanie tego problemu — chodziło o sprawdzenie, czy model:

- przekonamy się, że 6 punktów nie określa jasno funkcji,

- samo projektuje dane wejściowe falsyfikacji, które odróżniają hipotezę od konkurencyjnych hipotez,

- i szczerze przyznaje to, czego nie jest pewien.

I tu właśnie widać prawdziwe różnice. Niektóre modele toną w pewności siebie, inne — np. Claude Opus 4.7 — wyraźnie rozróżniają regułę symetryczną od asymetrycznej, proponują test typumep(5,2)(gdzie12 vs. 15decyduje o przemienności) i otwarcie mówią, że bez tego testu ich obliczeniamep(5,8)=45idap(5,8)=89są warunkowe na słuszności najprostszej hipotezy.

To jest dokładnie taki sposób myślenia, jakiego po prostu nie zobaczysz w zwykłych testach porównawczych. I właśnie dlatego warto od czasu do czasu pozwolić „dużym modelom” zadać małe, trudne pytanie.

Spróbuj rozwiązać zadanie — Ty czy Twój ulubiony model? Daj znać, jak wyszło.