Dritte Auflage der Olympischen Spiele in Data Science!

Was sagt ihr zur letzten Olympiade? Falls es jemandem entgangen sein sollte, fand Ende Mai bereits die dritte Auflage der Olympischen Spiele in Data…

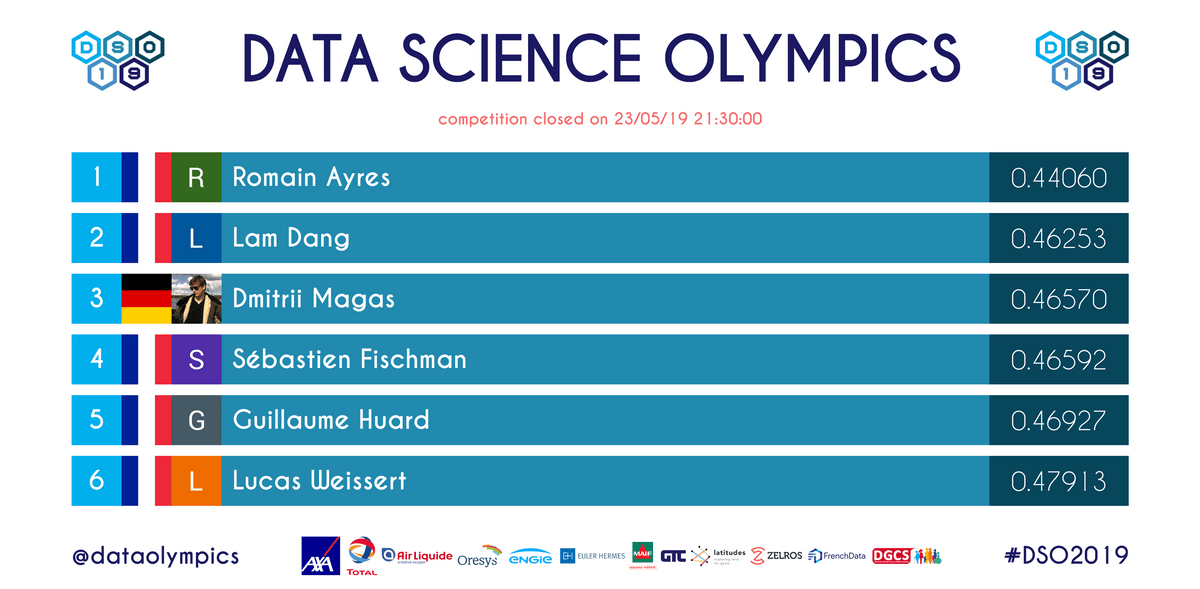

Was sagt ihr zur letzten Olympiade? Falls es jemandem entgangen sein sollte, fand Ende Mai bereits die dritte Auflage der Olympischen Spiele in Data Science statt! Es ist der größte Wettbewerb im maschinellen Lernen in Europa, an dem über 1000 Wissenschaftler gleichzeitig in Paris und Berlin teilnahmen. Alle „Sportler“ erhalten zu einem bestimmten Zeitpunkt eine Aufgabenstellung und haben 2 Stunden Zeit, um das genaueste prädiktive Modell zu entwickeln. Also etwas wie Kaggle, aber es dauert nicht 3 Monate, sondern nur zwei Stunden.

Ich weiß nicht, wie es euch geht, aber ich lerne gerne von den Besten, und so habe ich die Erkenntnisse des Siegers förmlich verschlungen (den gesamten Artikel findet ihr in den Links). Kurz gesagt, er gewann mit meinem Lieblingsalgorithmus LightGBM, der mit modifizierten kategorialen Variablen gefüttert wurde (Label-Encoding + Wertzählung + Target-Encoding). Es war herausfordernd herauszufinden, dass die Verlustfunktion optimiert werden muss (Fehler in der dritten Kategorie werden viel stärker bestraft als Fehler in der ersten). Genial!

Interessant war, dass der Champion Romain Ayres in kurzer Zeit auch andere Algorithmen ausprobierte, von denen ich erwartet hätte, dass sie großartig abschneiden.

Der Random Forest war im Vergleich zu LightGBM zu schwach. Neuronale Netzwerke waren für den Champion zu langsam – er hätte die Architektur nicht optimieren können und hatte keine GPUs zur Verfügung (hier hätte man vielleicht glänzen können). Und überraschenderweise funktionierte das Modell des Autors, das aus mehreren LightGBM (mit unterschiedlichen Seed-Variationen) bestand, nicht.

Eine interessante Beobachtung ist, dass ich, als ich den Code des Champions ausprobierte, eine alte Bibliothek LabelEncoder() verwendete, die in der neuesten Version nicht mit fehlenden Werten arbeitet. Der Meister verwendet also offensichtlich alte Versionen der Bibliotheken. Romain hatte während des gesamten Wettbewerbs auch Kopfhörer mit Musik auf den Ohren, sodass er nicht bemerkte, dass die Organisatoren in der Mitte des Wettbewerbs zusätzliche Daten hinzufügten, die das Ergebnis präzisieren konnten.

Quellen:

Olympiade: https://www.datascience-olympics.com/

Vier Tricks: https://medium.com/…/four-machine-learning-tricks-you-shoul…

Wie ich die Olympiade gewann: https://medium.com/…/how-i-won-the-data-science-olympics-20…

Sieger: https://medium.com/@romain.ayres

Originalquelle: wordpress

Související články

November 2019

Karen Hao analysierte fast 17.000 Forschungen zur künstlichen Intelligenz und schrieb einen Artikel darüber, wohin AI seiner Meinung nach steuert

LesenNovember 2019

Neue KI klont Ihre Stimme aus nur 5 Sekunden Sprachaufnahme!

LesenDezember 2019