Das Unternehmen Google hat diese Woche sein neuestes technologisches Spielzeug veröffentlicht – Bidirectional Encoder Representations Transformers, kurz BERT

Inwiefern unterscheidet sich BERT von klassischen NLP-Modellen wie word2vec und GloVe? Word2vec und andere Modelle erzeugen kontextfreie Wortdarstellungen. Jedes Wort…

Inwiefern unterscheidet sich BERT von klassischen NLP-Modellen wie word2vec und GloVe? Word2vec und andere Modelle erzeugen kontextfreie Wortdarstellungen. Jedes Wort wird als Vektor dargestellt (zum Beispiel 300 Zahlen, die dieses Wort mathematisch repräsentieren).

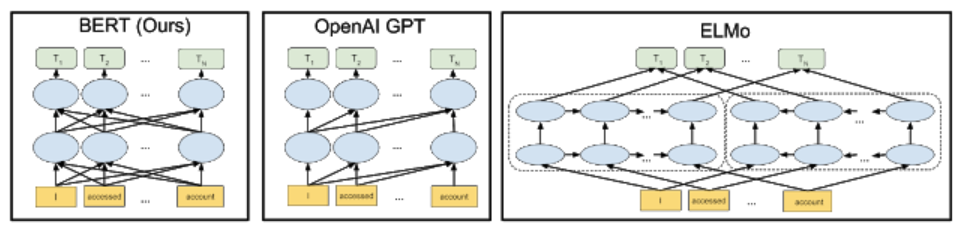

BERT ist einzigartig, weil es bidirektional ist. Dies ermöglicht ihm den Zugriff auf den Kontext aus vergangenen und zukünftigen Richtungen und das ohne Lehrer, was bedeutet, dass es Daten akzeptieren kann, die weder klassifiziert noch vom Menschen gekennzeichnet sind.

Während kontextfreie Modelle für das Wort „Auge“ beispielsweise eine numerische Repräsentation haben, kann BERT zwischen dem Auge im Kopf, dem Auge in der Suppe oder dem Wildererauge unterscheiden. BERT berücksichtigt den Kontext.

BERT lernt, Beziehungen zwischen Sätzen zu modellieren, indem es auf eine Aufgabe vortrainiert wird, die aus jedem beliebigen Korpus generiert werden kann, schrieben Devlin und Chang. Es basiert auf der Google Transformer-Plattform, einer Open-Source-Architektur für neuronale Netzwerke, die auf dem Mechanismus des self-focus optimiert ist und für NLP verwendet wird.

Bei Tests mit dem Stanford Question Answering Dataset (SQuAD), einem Datensatz mit Lesetexten, der Fragen zu einem Satz von Wikipedia-Artikeln enthält, erreichte BERT 93,2 % (was fast 2 % besser ist als die bisher besten Algorithmen und besser als der Mensch).

Originalartikel: https://ai.googleblog.com/…/open-sourcing-bert-state-of-art…

GitHub: https://github.com/google-research/bert

Autoren: Devlin, Jacob und Chang, Ming-Wei und Lee, Kenton und Toutanova, Kristina

Originalquelle: wordpress