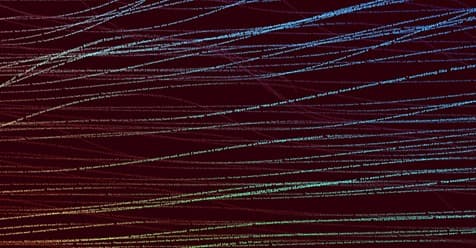

Tolle Neuigkeiten! OpenAI hat endlich sein größtes XLGPT-2-Modell mit 1,5 Milliarden Parametern und 48 Schichten veröffentlicht.

Ich finde es großartig, dass die Leute die Ausgaben von GPT-2 als sehr überzeugend empfinden. Bei dem größten Modell liegt das „Vertrauensscore“ bei 6,91 von 10. Das ist nur geringfügig…

Ich finde es großartig, dass die Leute die Ausgaben von GPT-2 als sehr überzeugend empfinden. Bei dem größten Modell liegt das „Vertrauensscore“ bei 6,91 von 10. Das ist nur geringfügig mehr als bei den Ausgaben des 774M-Modells (6,72) und deutlich mehr als beim mittleren Modell 355M (6,07). Der Unterschied zwischen dem großen und dem supergroßen Modell ist also relativ gering (oh mein Gott, das ist ein Satz :)). Das war wahrscheinlich der letzte Tropfen, der Open AI dazu brachte, das XL-Modell freizugeben.

Aus pragmatischer Sicht füge ich hinzu, dass das 774M-Modell nicht mehr auf dem kostenlosen Colab GPU trainiert/feinjustiert werden konnte.

Quelle: https://openai.com/blog/gpt-2-1-5b-release/…

Github: https://github.com/openai/gpt-2-output-dataset

Soziale Auswirkungen: https://d4mucfpksywv.cloudfront.net/papers/GPT_2_Report.pdf

Paper: https://d4mucfpksywv.cloudfront.net/…/language_models_are_u…

Původní zdroj: wordpress