Meine Damen und Herren, diese Woche sind wir Zeugen eines revolutionären Schrittes nach dem anderen

Zunächst veröffentlicht Nvidia den riesigen Megatron (das größte Modell der Welt, 5x größer als das größte GPT-2), darauf reagiert Open AI mit der Freigabe ihres großen Modells mit…

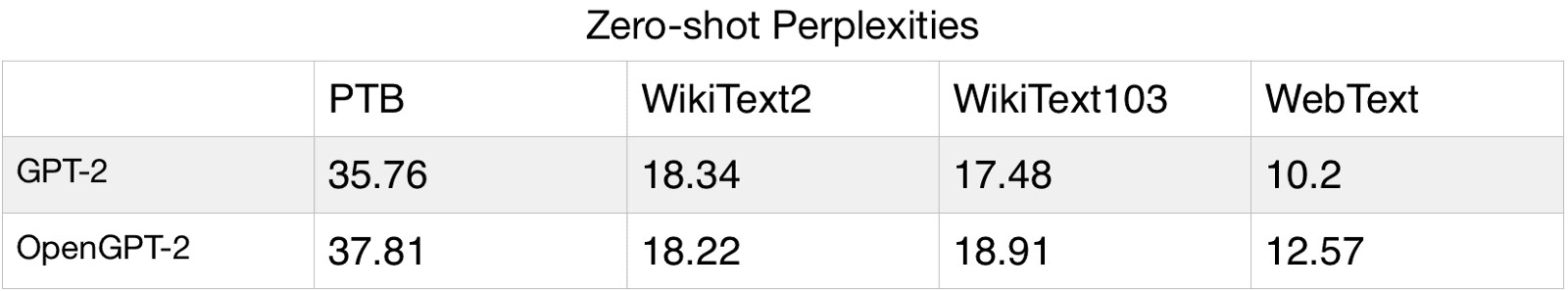

Zunächst veröffentlicht Nvidia den riesigen Megatron (das größte Modell der Welt, 5x größer als das größte GPT-2), darauf reagiert Open AI mit der Freigabe ihres großen Modells mit 800 Millionen Parametern. Dieser Schritt hat heute die Veröffentlichung des Modells der „Protestgruppe“ OpenGPT-2 mit 1,5 Milliarden Parametern ausgelöst – also einem Klon des absolut größten GPT-2-Modells. Und der gewöhnliche KI-Entwickler ist nur verwirrt und weiß nicht, welches Modell er zuerst ausprobieren soll.

Ich habe das heutige Modell (1,5B OpenGPT-2) gefragt, ob es den Satz „Weise Menschen sollten…“ vervollständigen könnte, und wie das Modell fortfuhr?

„ … Mitgefühl mit den Armen haben. Wenn sie das nicht tun, müssen sie mit ignoranten Denkweisen und einer schlechten Wirtschaft rechnen.

Staaten mit hohen Sozialausgaben sind Staaten mit der größten Armut. Je höher die Ausgaben für die soziale Sicherheit des Staates sind, desto höher ist die Armutsquote und desto teurer ist das System der sozialen Sicherheit. Tatsächlich sind Staaten mit der niedrigsten Armutsquote – je niedriger die Ausgaben für die soziale Sicherheit Ihres Staates sind, desto höher ist die Armutsquote.“

Wenn Sie mehr über dieses Modell lesen oder es selbst ausprobieren möchten, schauen Sie hier vorbei: https://medium.com/…/opengpt-2-we-replicated-gpt-2-because-…

Původní zdroj: wordpress

Související články

September 2020

Ein interessanter Artikel über GPT-3

LesenNovember 2019

Tolle Neuigkeiten! OpenAI hat endlich sein größtes XLGPT-2-Modell mit 1,5 Milliarden Parametern und 48 Schichten veröffentlicht.

LesenOktober 2019