Blog

Najstarszyblog o sztucznej inteligencji w Czechach

O sztucznej inteligencji piszemy od 2017 roku. 1000+ artykułów, tysiące stron przemyśleń, eksperymentów i refleksji. Bez szumu i reklam.

Filtr tagów: BERT × anuluj

▸Przeglądaj według tematu

Tematy

Wyświetlono 7 z 7 artykułów

Archiwum 2021

Archiwum 2021Nový šampión na scéně?

Jazykový model Switch Transformer od společnosti Google je téměř šestkrát větší než GPT-3! Switch Transformer má 9x více parametrů tedy 1,6 bilionu. Google optimalizoval…

Czytaj Archiwum 2021

Archiwum 2021Ohlédnutí za minulou dekádou

Nenajdete tam sice rok 2020 nebo třeba GPT, ale celkově moc povedené:) https://towardsdatascience.com/the-decade-of-artificial…

Czytaj Archiwum 2019

Archiwum 2019Výstupy z AI zkoumala konference NeurIPS. K čemu dospěla?

Nedávno se v kanadském Vancouveru konala konference Neural Information Processing Systems (NeurIPS), na které se shromáždilo více než 13 000 vědců z různých oborů….

Czytaj Archiwum 2019

Archiwum 2019Další kurz splněn

Právě jsem dokončil kurz „Learn BERT – most powerful NLP algorithm by Google“. Je to pokročilejší kurz, který jak teoreticky, tak i prakticky seznamuje…

Czytaj Archiwum 2019

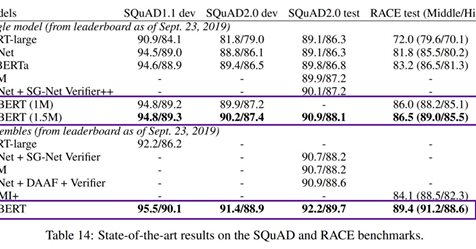

Archiwum 2019Nejnovější model umělé inteligence pro zpracování přirozeného jazyka – ALBERT!

Mezi nejlepší modely umělé inteligence pro zpracování přirozeného jazyka (Bert, Robert, GPT-2 či Megatron) přišel minulý týden další hráč ALBERT! Alberta nám přináší společnosti…

Czytaj Archiwum 2019

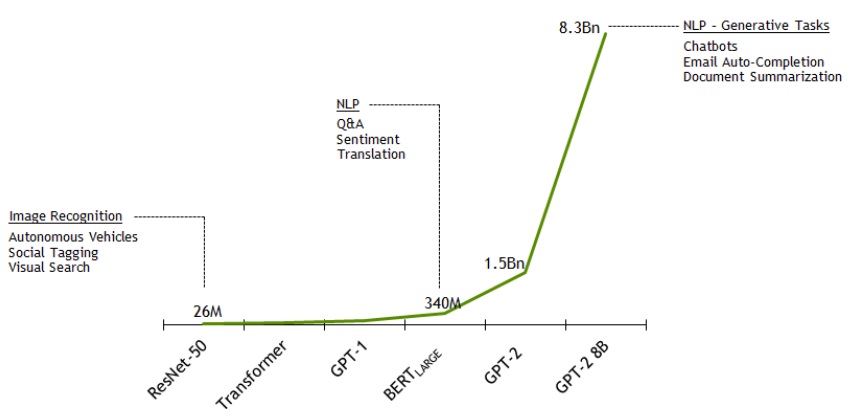

Archiwum 2019Společnost Nvidia oznámila, že vyškolila největší jazykový model na světě GPT-2 8B!

Model používá 8,3 miliardy parametrů a je 24krát větší než BERT a 5krát větší než doposud největší GPT-2 od OpenAI. Nvidia použila paralelismus, který…

Czytaj Archiwum 2018

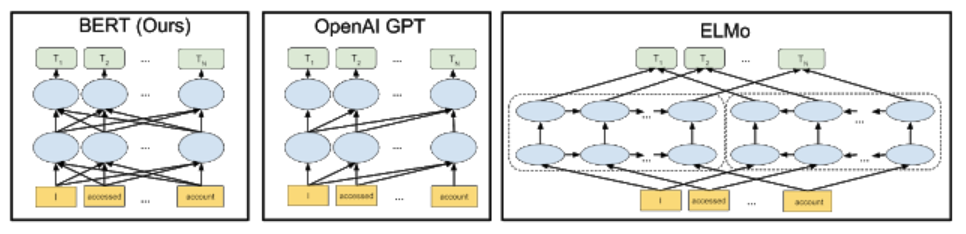

Archiwum 2018Společnost Google tento týden zveřejnila svou nejmodernější technologickou hračku – Bidirectional Encoder Representations Transformers neboli BERT

V čem se BERT liší klasických NLP modelů, jako jsou word2vec a GloVe? Word2vec a ostatní modely totiž generují bezkontextové vkládání slov. Každé slovo…

Czytaj