Das Google Research Brain-Team stellte die neue Architektur für Computer Vision MLP-Mixer vor

In letzter Zeit sind netzwerkbasierte Modelle, die auf Aufmerksamkeit basieren, wie der Vision Transformer, populär geworden. In einem Beitrag des Google Research Brain-Teams stellte eine Gruppe von Wissenschaftlern den MLP-Mixer vor,…

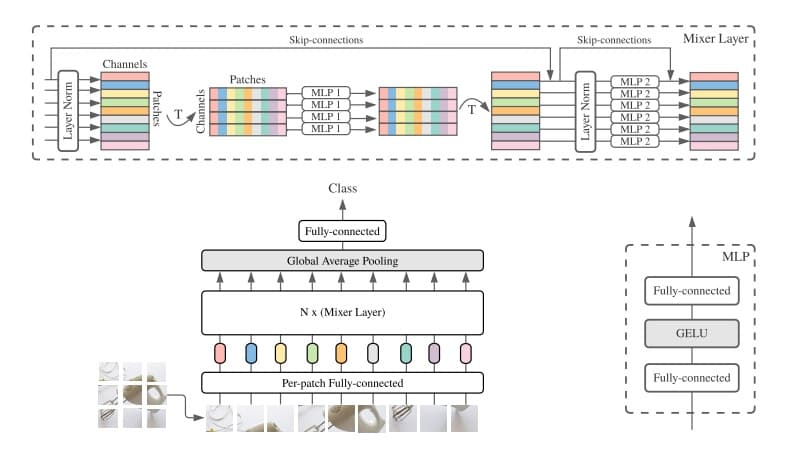

In letzter Zeit sind netzwerkbasierte Modelle, die auf Aufmerksamkeit basieren, wie der Vision Transformer, populär geworden. In einem Beitrag des Google Research Brain-Teams stellte eine Gruppe von Wissenschaftlern den MLP-Mixer vor, eine Architektur, die ausschließlich auf mehrschichtigen Perzeptronen (MLP) basiert. Der MLP-Mixer enthält zwei Arten von Schichten: eine mit MLP, die unabhängig von den Bild-Patches angewendet werden (d.h. „Mischen“ von Funktionen nach Ort) und eine andere mit MLP across patches (d.h. „Mischen“ von räumlichen Informationen). Als der MLP-Mixer auf großen Datasets trainiert wurde, erzielte er ähnliche Ergebnisse wie die neuesten Modelle. Die Gruppe von Wissenschaftlern hofft, dass diese Ergebnisse weitere Forschungen über die gut etablierten CNNs und Transformer hinaus anregen werden.

Původní zdroj: wordpress