Společnost Nvidia oznámila, že vyškolila největší jazykový model na světě GPT-2 8B!

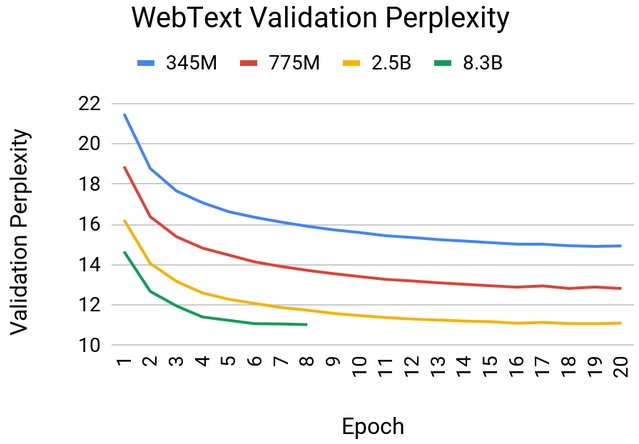

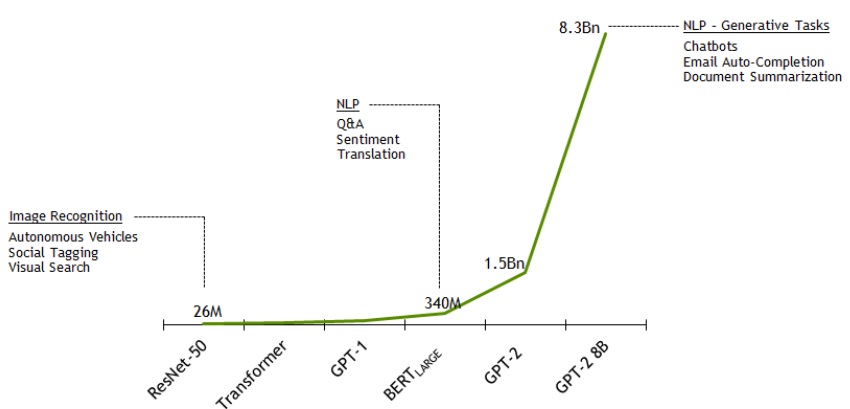

Model používá 8,3 miliardy parametrů a je 24krát větší než BERT a 5krát větší než doposud největší GPT-2 od OpenAI. Nvidia použila paralelismus, který…

Model používá 8,3 miliardy parametrů a je 24krát větší než BERT a 5krát větší než doposud největší GPT-2 od OpenAI. Nvidia použila paralelismus, který rozdělil neuronovou síť na kousky, které se vždy vejdou do paměti jedné GPU.

Společnost Nvidia také oznámila nejrychlejší časy ve školení modelu BERT. BERT-Large model dokázali pomocí optimalizovaného softwaru PyTorch a DGX-SuperPOD s 1472 GPU(V100), natrénovat za rekordních za 53 minut! Tento výkon jsme ještě na začátku tohoto roku počítali na týdny!

Zdroj: https://devblogs.nvidia.com/training-bert-with-gpus/

Github: https://github.com/nvidia/megatron-lm

Původní zdroj: wordpress